ワークフローを改良しました

ComfyUI-IF_AI_toolsが使えなくなっている

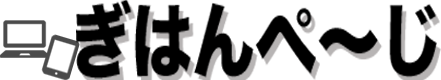

以前の記事でOllamaを使ったローカルLLMを利用して,ComfyUIで画像からプロンプトを生成して新たな画像を生成するワークフローを紹介しました。久しぶりにそのワークフローを開いてみると,利用していたComfyUI-IF_AI_toolsというカスタムノードが使えなくなっていました。

最近,色々なワークフローを試すたびに様々なカスタムノードをインストールすることが多かったので,それが原因かと思い,再インストールを試みましたが,問題を解決することはできませんでした。

comfyui-ollamaを使ってみる

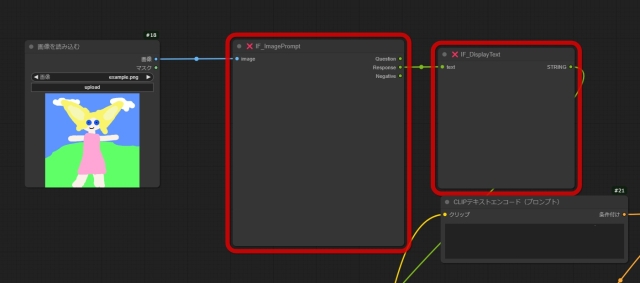

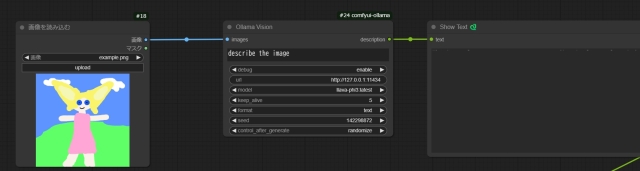

気を取り直して代替可能なカスタムノードを探すことにし,こちらの記事で紹介されているcomfyui-ollamaを使ってみることにしました。インストール後,ollama-visionとshow textという2つのノードを呼び出して使えなくなったノードと入れかえました。

サンプルの画像をセットしてワークフローを実行してみると,無事に画像が生成されました。しかし,生成時間にはばらつきがあり,かなりの時間がかかることもありました。上記の記事によると,GPUメモリの管理が上手くできていないことが原因で,ComfyUIとOllamaが互いにGPUメモリの奪い合いをしているとのことでした。

解決方法についても記載されていたので,記事の通りにComyUI-Impact-Packというカスタムノードをインストールして,Sleepノードを呼び出して設定したところ,生成時間が最初の1枚が40秒,2枚目以降は20秒程度で安定するようになりました。

(生成時間は利用するLLMによって異なるようです)

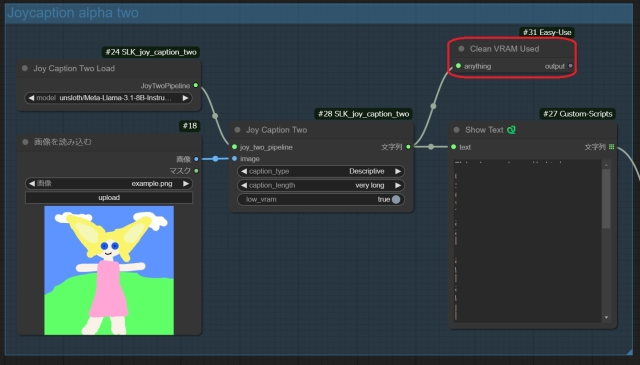

Joycaption Alpha Two for ComfyUIを使ったワークフローも改良

Joycaption Alpha Two for ComfyUIカスタムノードを使ったワークフローも以前の記事で紹介していましたが,このワークフローも最初の1枚を生成するのにかなりの時間がかかっていました。(特にkSamplerノードの処理が劇遅でした)

この現象もGPUメモリの管理が上手くできていないことが原因ではないかと思い,Easy-Useカスタムノードの中のというClean VRAM Usedノードを利用して,Joycaption利用後にVRAMを開放するようにしたところ,最初の1枚の生成時間が2分弱に短縮されました。最初にワークフローを作成したときはうまくいかなかったので,解決できてよかったです。

動作は微妙に異なる

上記2つのワークフローはどちらもLLMを使ってComfyUIで画像からプロンプトを生成して新たな画像を生成するワークフローですが,動作が少し異なります。

ローカルLLMを使ったワークフローは同じ元画像でも生成するごとにプロンプトを作り直すようで,生成する度に違った印象の画像が出力されます。Joycaptionを使ったワークフローは元画像が同じときはプロンプトを作り直さないので生成時間は速く,ある程度統一された画像が出力されます。

今のところはPony系モデルで生成するワークフローにしていますが,次はFLUX.1でも利用できるようにする予定です。

この記事へのコメント

コメントはまだありません。

コメントを送る